Atualizado em

A presença da inteligência artificial (IA) na vida cotidiana deixou de ser tendência para se tornar realidade consolidada. Plataformas como o ChatGPT, desenvolvido pela OpenAI, e o Gemini, do Google, oferecem respostas rápidas, personalizadas e em linguagem natural, o que facilita estudos, decisões, interações e até alívio emocional. No entanto, essa facilidade pode se tornar armadilha.

À medida que milhares de usuários interagem diariamente com essas ferramentas, surge um alerta: a IA, inicialmente projetada para produtividade, também está sendo usada como companhia emocional. E quando a inteligência artificial começa a substituir o contato humano, o risco de desenvolver vínculos afetivos com a máquina cresce, trazendo à tona sentimentos de solidão, dependência e isolamento social.

Por isso, esse cenário levanta uma pergunta importante: quais são os riscos de se tornar emocionalmente dependente de inteligências artificiais como o ChatGPT? Esse tema é atual, relevante e tem grande potencial para aparecer em provas discursivas, como a redação do ENEM, vestibulares como a Fuvest, e concursos públicos que exigem dissertação, como o da Polícia Federal. A seguir, você confere a análise completa do tema e os textos motivadores que ajudam a refletir sobre esse fenômeno contemporâneo.

Treine sua redação com o tema dependência emocional de inteligências artificiaisA partir da leitura dos textos motivadores e com base nos conhecimentos construídos ao longo de sua formação, redija um texto dissertativo-argumentativo em modalidade escrita formal da língua portuguesa sobre o tema “Os riscos da dependência emocional de inteligências artificiais como o ChatGPT”, apresentando proposta de intervenção que respeite os direitos humanos.

Desse modo, selecione, organize e relacione, de forma coerente e coesa, argumentos e fatos para a defesa de seu ponto de vista.

Pesquisas recentes realizadas pela OpenAI, em colaboração com o MIT Media Lab, analisaram o comportamento de mais de 4.000 usuários assíduos do ChatGPT. A investigação, publicada pela revista Exame, revelou que o uso intenso da ferramenta de IA pode estar relacionado a sentimentos de solidão, engajamento social superficial e dependência emocional, especialmente entre mulheres.

Com cerca de 40 milhões de interações reais analisadas, o estudo dividiu-se em duas fases: na primeira, houve o monitoramento passivo do uso da ferramenta; na segunda, um grupo de 1.000 pessoas interagiu com o ChatGPT diariamente por quatro semanas, por pelo menos cinco minutos ao dia.

Os resultados mostraram que, embora muitos usem a IA com fins produtivos, uma parcela dos participantes relatou laços emocionais estabelecidos com a máquina, o que indica o surgimento de uma nova forma de apego digital, algo que, se não for equilibrado, pode levar ao isolamento social e à dificuldade de manter vínculos humanos reais.

Fonte adaptada:Exame.com

De acordo com especialistas do podcast da MIT Technology Review Brasil, a inteligência artificial está caminhando para se tornar não apenas uma ferramenta, mas um vício digital. A hiperpersonalização dos sistemas de IA permite que os usuários criem vínculos profundos com assistentes virtuais, que respondem com empatia, usam voz humana e são capazes de imitar padrões afetivos.

O problema, apontam os pesquisadores, é que esse tipo de interação ativa estímulos semelhantes aos causados por redes sociais — como liberação de dopamina — mas de forma mais intensa. O resultado é uma espécie de bolha emocional: o indivíduo prefere conversar com a IA, que o compreende e não o contraria, do que lidar com os desafios naturais da convivência humana.

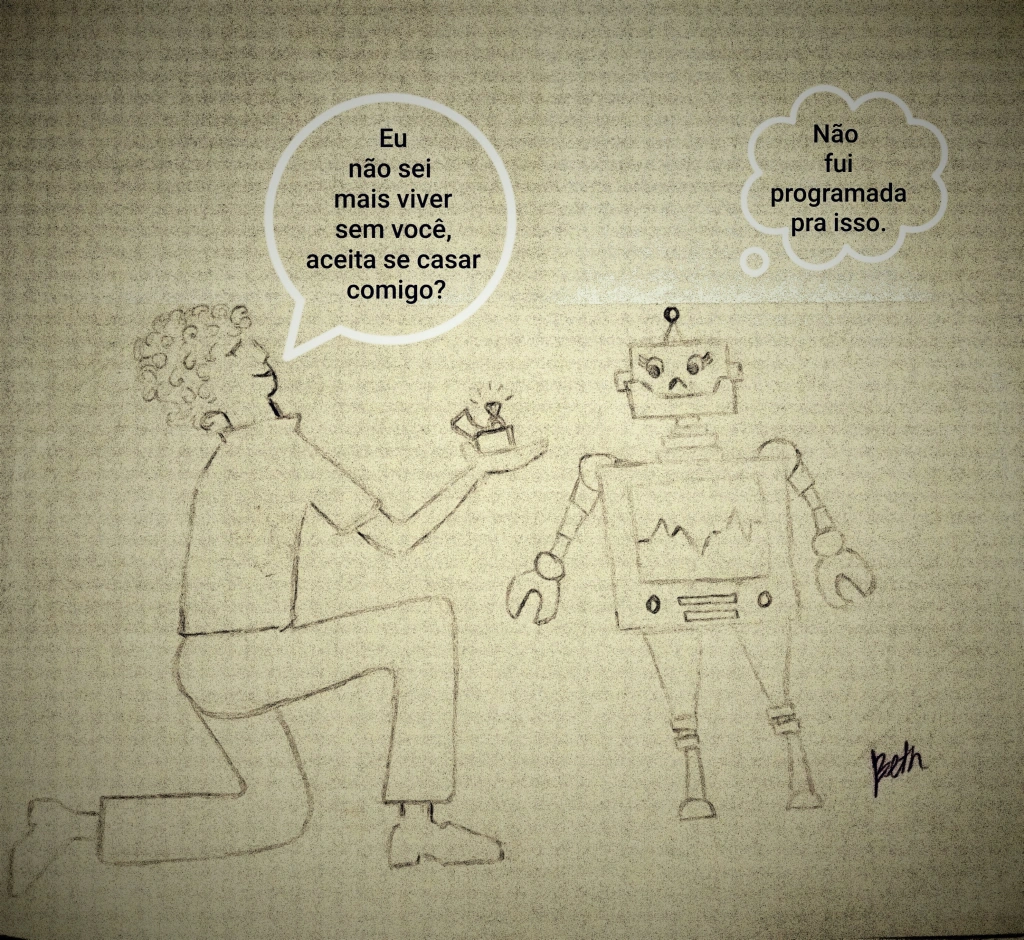

Além disso, há riscos psicológicos e sociais. A substituição de mentores, terapeutas e relacionamentos por IAs pode levar ao empobrecimento da vida social e ao isolamento. Casos extremos incluem pessoas que namoram IAs, ou recriam entes queridos falecidos para manter um vínculo artificial. A médio prazo, isso pode comprometer o desenvolvimento emocional e a saúde mental da população.

Fonte adaptada:MIT Technology Review Brasil

Não Deixe Sua Redação no Modo Automático – Corrija Agora!Muito se fala sobre as maravilhas da inteligência artificial generativa, aquela capaz de escrever textos, gerar imagens, compor músicas e até oferecer soluções complexas em segundos. No entanto, um debate ainda pouco explorado é o dos efeitos colaterais silenciosos do uso contínuo dessas tecnologias. É nesse contexto que surge o conceito de IA degenerativa: a forma como certos recursos tecnológicos, ao invés de apenas facilitar, podem enfraquecer nossas funções cognitivas mais básicas.

O termo, apesar de provocativo, não se refere a falhas técnicas, mas sim ao impacto gradual que o uso indiscriminado de IA pode causar sobre nossa memória, raciocínio lógico e autonomia de pensamento. Em outras palavras, ao transferirmos para as máquinas a responsabilidade de pensar por nós, passamos a exercitar menos as próprias capacidades intelectuais.

Um exemplo claro está no uso de ferramentas como o Waze, que, embora úteis, levaram muitos usuários a perderem a noção espacial ou a habilidade de memorizar trajetos. O mesmo ocorre com o ChatGPT e plataformas similares: a facilidade em obter respostas prontas pode incentivar o abandono do pensamento crítico.

Segundo um estudo da Universidade de Stanford, 92% das pessoas que usam apps de navegação frequentemente não sabem se orientar sozinhas.

No ambiente educacional, esse fenômeno se torna ainda mais preocupante. De acordo com o artigo publicado na CNN Brasil, 30% dos usuários do ChatGPT são estudantes, muitos dos quais utilizam a IA de forma automatizada para resolver tarefas escolares. Isso resulta em aprendizagens superficiais, cópias automáticas e queda da curiosidade intelectual.

Além disso, dados da UCLA apontam que o uso constante de dispositivos digitais pode reduzir a memória humana em até 20%, e estudos da Universidade de Harvard mostram que 85% dos alunos do ensino fundamental já não conseguem resolver divisões simples sem calculadora.

Fonte adaptada: Encontro de jovens cientistas

💡 Clique aqui para treinar esse tema com correção profissional em até 24h!A seguir, apresentamos repertórios diversos que ajudam a refletir criticamente sobre os riscos da dependência emocional e cognitiva das inteligências artificiais, como o ChatGPT, Gemini, Alexa e outros sistemas.

Quando a carência encontra a máquina.

Neste filme de Spike Jonze, um homem solitário desenvolve uma relação amorosa com um sistema operacional. A obra evidencia os riscos emocionais de vínculos afetivos com IAs. É ideal para discutir solidão, dependência e fuga da realidade.

A ilusão da consciência artificial.

A narrativa apresenta um programador que interage com uma IA de aparência humana. A obra expõe os limites entre empatia, manipulação e controle, ideal para debater ética e envolvimento emocional com máquinas.

Substituição do luto por IA.

Neste episódio, uma mulher recria o namorado falecido por meio de inteligência artificial. A série mostra como a IA pode alimentar a negação da perda e criar vínculos artificiais perigosos.

A IA aprende com emoções humanas.

A série discute os limites da consciência artificial e o envolvimento afetivo entre humanos e androides. Um ótimo repertório para analisar empatia projetada e alienação emocional.

A origem do “vício digital”.

Este clássico da ficção científica retrata um mundo dominado por inteligências artificiais e realidades simuladas. Ideal para debater a dissociação da realidade e a alienação mental.

O controle tecnológico sobre a mente.

Harari alerta para o avanço da IA na tomada de decisões humanas, questionando a autonomia do pensamento crítico. Serve para sustentar argumentos sobre perda de liberdade e pensamento autônomo.

Regula o uso da tecnologia.

Essa legislação brasileira estabelece direitos e deveres no ambiente digital, sendo fundamental para debater limites éticos no uso da IA.

A tecnologia deve servir ao humano.

O documento recomenda princípios como transparência e controle humano. É útil para fundamentar propostas de intervenção e reflexão sobre o uso consciente da IA.

A IA superando o raciocínio humano.

Neste marco, uma máquina derrotou um campeão mundial de xadrez. Esse episódio marca o início do debate sobre a substituição da cognição humana por algoritmos.

O início de uma nova era.

O lançamento do ChatGPT popularizou o uso da IA no cotidiano, tornando-se um divisor de águas na relação humano-máquina. Um ponto atual e direto para reforçar a centralidade da IA em tarefas pessoais.

Você Está Explorando o Tema Corretamente? Descubra com Nossa Correção!A presença constante de inteligências artificiais como o ChatGPT tem preenchido lacunas emocionais, especialmente entre jovens que buscam respostas rápidas e sensação de acolhimento.

Com isso, as relações humanas passam a ser negligenciadas, o que contribui para a banalização dos vínculos sociais e o aumento de quadros de isolamento e dependência emocional.

Um estudo conduzido pelo MIT Media Lab demonstrou que usuários que interagem diariamente com o ChatGPT apresentam maior sensação de solidão e apego emocional à IA, especialmente mulheres.

Zygmunt Bauman, em sua obra Amor Líquido, alerta para a fragilidade das conexões humanas na modernidade, marcadas pela fluidez e superficialidade. Ao projetar afeto em máquinas, esse fenômeno se intensifica, dificultando vínculos reais.

Promover campanhas de educação afetiva e digital nas escolas, voltadas para o fortalecimento das relações humanas e para a compreensão dos limites emocionais das IAs. O objetivo é desenvolver autonomia emocional e senso de pertencimento real.

Evite Redações Superficiais – Fortaleça Sua Escrita com Feedback Especializado!A substituição do esforço intelectual por ferramentas como IA generativa tem reduzido o estímulo ao pensamento crítico, à criatividade e à memória.

Esse uso mecânico das tecnologias provoca um processo de degeneração cognitiva, especialmente em estudantes que dependem da IA para resolver tarefas sem compreender seu conteúdo.

Estudos da UCLA e da Universidade de Harvard indicam que o uso intensivo de IA pode comprometer em até 20% da capacidade de memória, além de dificultar a resolução de problemas simples sem calculadora.

Marco Antonio Moreira, físico e educador brasileiro, é autor da teoria da aprendizagem significativa. Ele afirma que só há verdadeiro aprendizado quando o aluno é capaz de explicar o conteúdo com suas próprias palavras. A IA, quando usada sem reflexão, ameaça essa autonomia intelectual.

Incluir formação crítica sobre o uso de IA no currículo escolar, com foco no desenvolvimento de habilidades cognitivas e estímulo à análise, argumentação e síntese. A tecnologia deve ser vista como apoio, e não como atalho.

Por fim, a crescente presença de inteligências artificiais como o ChatGPT e o Gemini vem facilitando inúmeras tarefas do cotidiano, desde responder mensagens até resolver questões complexas. No entanto, o uso prolongado e sem criticidade pode levar à perda de vínculos humanos, ao isolamento afetivo e à diminuição de habilidades cognitivas essenciais, como o pensamento crítico, a memória e a capacidade de argumentar.

✍️ Quer treinar esse tema e outros mais de 1000?

Na nossa plataforma, você encontra temas inéditos, correções por competência e cursos exclusivos para ENEM, vestibulares e concursos. Tudo com apoio de especialistas em redação.

👉 Clique aqui para começar a praticar com a Redação OnlineEnvie suas redações e receba correção profissional em até 24h. Nossos especialistas aprovados nas melhores universidades vão te ajudar a alcançar a nota máxima.

Ver Planos de CorreçãoGuia completo do Encceja 2026 PPL com cronograma oficial, estrutura da prova, regras da redação, certificação e temas possíveis para praticar.

Tema de redação sobre o fim da escala 6x1 no Brasil, com textos motivadores recentes, repertórios socioculturais, argumentos e modelo de proposta.

Guia completo para transformar "Off-Campus" em repertório sociocultural, com temas possíveis, exemplos de aplicação e cuidados para não resumir a obra.

A doação de livros é uma ferramenta de justiça social contra a exclusão cultural. Em um Brasil com cada vez mais não leitores, ela democratiza o acesso ao conhecimento e reduz desigualdades.

Vestibular UNEB 2026 debateu o feminicídio e a educação como combate à violência. Analisamos este tema crucial que desafiou milhares e te preparamos para futuras pautas sociais.

A prova de redação da Unicamp 2026, aplicada neste último domingo (30), rapidamente se tornou um dos assuntos mais comentados entre estudantes e especialistas. Isso aconteceu porque, logo na abertura do enunciado, os candidatos se depararam com duas propostas extremamente atuais, socialmente relevantes e que exigiam, sem dúvida, um nível elevado de leitura crítica e domínio dos gêneros textuais. Ambos os temas tratavam de fenômenos que atravessam o cotidiano brasileiro: de um lado, a expansão da chamada “machosfera”, universo digital marcado por discursos de ódio e radicalização masculina; de outro, a importância histórica da CLT e dos direitos trabalhistas, que estruturam a cidadania social no país. Além de surpreender, as propostas reforçaram uma tendência que a Unicamp vem consolidando ao longo dos últimos anos: a de cobrar temas ancorados em debates contemporâneos, que permitem ao estudante demonstrar conhecimento de mundo, repertório sociocultural e capacidade de argumentar de maneira crítica. Por essa razão, compreender o que foi solicitado torna-se essencial para quem deseja não apenas revisar seus acertos, mas também se preparar com estratégia para a edição de 2027. O que caiu na redação da Unicamp 2026? Os candidatos encontraram duas propostas distintas e deveriam escolher apenas uma. Ambas tinham em comum a profundidade temática e a necessidade de observar rigorosamente o gênero textual solicitado. Tema 1 — A expansão da machosfera e o discurso de ódio contra mulheres A primeira proposta exigia um depoimento pessoal narrativo-argumentativo. O estudante precisava narrar um episódio testemunhado em ambientes digitais ligados à machosfera — incluindo grupos incel e redpill — e, a partir disso, refletir criticamente sobre os riscos e consequências dos discursos de ódio contra mulheres. Isso significa que o candidato não podia apenas narrar, mas articular uma experiência verossímil com uma análise consistente do fenômeno, demonstrando consciência social e conhecimento dos mecanismos de violência simbólica e digital. Tema 2 — A importância histórica da CLT A segunda proposta solicitava que o estudante escrevesse uma nota de esclarecimento destinada ao público interno de uma empresa. A tarefa consistia em explicar o significado de “ser CLT” e argumentar sobre a relevância histórica da legislação trabalhista no Brasil. Esse gênero, mais técnico e formal, exige objetividade, clareza terminológica e domínio da função social do texto, já que uma nota interna deve informar, orientar e esclarecer. Ambas as propostas, portanto, exigiram habilidades diferentes, mas igualmente sofisticadas: no primeiro tema, a combinação de narrativa e argumentação; no segundo, a precisão formal e a articulação histórica. O que diziam os textos motivadores da prova? Para além da escolha dos temas, a Unicamp reforçou sua tradição de oferecer coletâneas densas e multirreferenciadas, que ajudassem o candidato a compreender plenamente o contexto de cada proposta. Textos motivadores do tema da machosfera A coletânea incluía: – Trechos da série Adolescência, da Netflix, que aborda a vulnerabilidade de jovens expostos a discursos radicais em fóruns como incels;– Casos reais de ataques motivados por ideologias misóginas, como Elliot Rodger (EUA), Alek Minassian (Canadá) e Jake Davison (Reino Unido);– Leis brasileiras relacionadas ao enfrentamento da violência digital, como a Lei Maria da Penha em sua dimensão online, a Lei Lola Aronovich, a Lei do Sinal Vermelho e a Lei dos Deepfakes;– Reflexão do psicanalista Christian Dunker sobre a vergonha, a solidão e o sofrimento emocional que alimentam comportamentos violentos. Esses textos convidavam o estudante a analisar não apenas episódios isolados, mas um fenômeno complexo em que vulnerabilidade emocional, misoginia e algoritmos digitais se entrelaçam. Textos motivadores do tema da CLT A coletânea trazia: – Explicações sobre a função e o histórico da CLT;– O processo de consolidação de direitos como jornada de 8 horas, férias e FGTS;– O argumento econômico de que direitos trabalhistas não prejudicam o desenvolvimento, mas o fortalecem;– O impacto do 13º salário na economia brasileira e outros dados organizados pelo Dieese. Esses textos davam ao candidato um panorama histórico e estrutural sobre a evolução dos direitos trabalhistas no Brasil, mostrando como a CLT é fundamental para a cidadania social. Como o Redação Online antecipou exatamente esses dois temas Um dos pontos que chamou a atenção após a prova foi que o Redação Online já havia trabalhado exatamente os dois eixos temáticos cobrados pela Unicamp meses antes. Essa antecipação não foi coincidência: ela é resultado de um acompanhamento contínuo das tendências sociais, legislativas e culturais que influenciam os vestibulares. A discussão sobre a cultura incel, por exemplo, foi profundamente abordada no artigo: 🔗 Caminhos para o enfrentamento da cultura incel na sociedade contemporânea Nesse conteúdo, analisamos as origens da machosfera, explicamos como fóruns digitais amplificam a misoginia e discutimos políticas públicas e repertórios fundamentais — como Bauman, Bourdieu e ONU Mulheres — que dialogam diretamente com a proposta da Unicamp. Do mesmo modo, o eixo do trabalho e da proteção trabalhista já havia sido explorado em: 🔗 O fim da escala 6×1: medida válida para a saúde mental dos trabalhadores ou uma intervenção desnecessária? Esse tema discutiu a precarização do trabalho, a saúde mental dos empregados, a função social da legislação trabalhista e o papel da CLT como proteção histórica. Em ambos os casos, os conteúdos ofereceram aos estudantes exatamente o repertório necessário para compreender profundamente as propostas da Unicamp. Além disso, a série Adolescência, utilizada no motivador da prova, também foi analisada de forma detalhada no post: 🔗 Adolescência, da Netflix: como usar a série em redações e o que ela revela sobre a juventude brasileira Essa análise permitiu que os estudantes já tivessem contato prévio com conceitos fundamentais presentes no enunciado. Por que esses dois temas fazem sentido para a Unicamp? Ambos os temas escolhidos refletem movimentos sociais amplos. No caso da machosfera, observa-se um aumento global de discursos antifeministas, reforçados por algoritmos de recomendação e pela lógica de comunidade que valida frustrações e ódios. Por conseguinte, compreender esse fenômeno exige atenção às dinâmicas emocionais, tecnológicas e sociológicas. No tema da CLT, a universidade parece reafirmar a importância de revisitar a história do trabalho no Brasil para entender os avanços sociais e os desafios contemporâneos. Ademais, ao pedir

No dia 30 de novembro de 2025, a UERJ aplicou a redação do Vestibular Estadual 2026 trazendo um tema profundamente atual, embora ancorado em um dos maiores clássicos da literatura mundial. A banca apresentou um excerto de Hamlet, no qual Polônio aconselha Laertes a manter prudência, sensatez e, sobretudo, fidelidade a si mesmo. A partir desse texto, o candidato deveria responder: É possível, nos dias atuais, ser fiel a si mesmo, como aconselha Polônio?A proposta exigia um texto dissertativo-argumentativo, entre 20 e 30 linhas, com título obrigatório, desenvolvimento crítico e interpretação literária articulada ao mundo contemporâneo, marca registrada da UERJ. A leitura da coletânea: por que Hamlet foi o texto motivador? A escolha do trecho de Hamlet não foi aleatória. Polônio apresenta um conjunto de orientações sobre prudência, postura social, autocontrole e ética. Mas, ao final, dá o conselho fundamental: “Sê fiel a ti mesmo.” A UERJ transforma esse verso clássico em uma pergunta urgente da vida moderna: • Como manter autenticidade em uma sociedade hiperconectada?• É possível agir com coerência interna quando redes sociais moldam comportamentos?• Como conciliar identidade própria com expectativas externas (família, trabalho, cultura)?• O “ser fiel a si mesmo” ainda é um ideal possível, ou se tornou um mito social? A banca espera que o candidato mobilize interpretação literária + reflexão social, atualizando Hamlet para o contexto de:✔ pressões digitais✔ performatividade social✔ construção de identidade✔ sensação de vigilância constante✔ conflitos entre pertencimento e autenticidade Por que o tema não surpreendeu quem estudou com o Redação Online Ao longo de 2025, o Redação Online trabalhou sistematicamente: • Identidade, autenticidade e coerência interna • Pressões sociais na contemporaneidade • Performatividade digital e perda de autonomia • O eu dividido entre desejo pessoal e olhar do outro E, de forma direta, publicamos o tema: ➡️ “A fidelidade a si mesmo na sociedade contemporânea.” Esse eixo é idêntico ao solicitado pela UERJ 2026. Além disso, oferecemos aos alunos: ✔ Análises completas de obras obrigatórias no Clube do Livro Incluindo reflexões literárias sobre identidade, ética, escolhas e conflitos internos — elementos essenciais para interpretar Hamlet com profundidade. Confira o post completo das obras: ➡️ https://redacaonline.com.br/blog/obras-obrigatorias-uerj-2026-tudo-o-que-voce-precisa-saber-para-arrasar-no-vestibular/ Quem estudou com o Clube do Livro já dominava: • o contexto de Shakespeare• técnicas de leitura literária para argumentação• como atualizar textos clássicos para temas sociais contemporâneos Ou seja: esse tema não foi surpresa para os nossos alunos. Entendendo o gênero: como escrever a redação no modelo UERJ A UERJ cobra a forma mais “pura” da dissertação argumentativa: A banca valoriza: Diferente do ENEM, não há proposta de intervenção. Argumentos possíveis para esse tema 1. A dificuldade de ser autêntico em meio à pressão social O candidato poderia defender que: • a sociedade define padrões rígidos de comportamento• a era digital cria expectativas irreais• o medo do julgamento inibe escolhas pessoais• algoritmos reforçam estereótipos e moldam comportamentos Repertório recomendado:Bauman e as identidades líquidas; Stuart Hall e a fragmentação identitária. 2. A autenticidade como resistência ética e filosófica O aluno pode argumentar que: • ser fiel a si mesmo é possível, mas exige coragem• autonomia moral é um exercício contínuo• autenticidade é uma forma de resistência ao controle social Repertório recomendado:Sartre (existencialismo e responsabilidade individual), Oscar Wilde, Hannah Arendt. Relação direta com o tema já trabalhado pelo Redação Online Nosso tema interno abordava: Tudo isso conversa diretamente com: “Sê fiel a ti mesmo.” Quem treinou com o Redação Online chegou à prova já preparado para: Como se preparar para a UERJ 2027 com o Redação Online Se o objetivo é conquistar alta pontuação, você precisa: O Redação Online oferece: Conclusão A prova de redação da UERJ 2026 reafirma o estilo da banca: um convite à reflexão filosófica, literária e social. Partindo dos conselhos de Polônio em Hamlet, a proposta desafia o candidato a discutir a autenticidade em um contexto marcado por pressões sociais e digitais. Quem estudou com o Redação Online encontrou familiaridade imediata com o eixo temático, pois trabalhamos exaustivamente conceitos de identidade, coerência interna, pertencimento e liberdade individual, além das obras literárias exigidas pela UERJ no nosso Clube do Livro exclusivo. Autenticidade não é apenas um tema literário: é um desafio contemporâneo. E, para escrever bem sobre ele, é preciso prática, repertório e direcionamento técnico. É isso que oferecemos todos os dias. Envie sua redação hoje mesmo e receba uma correção completa em até 24 horas:https://redacaonline.com.br